近期,北京理工大学信息与电子学院李伟教授、硕士生翁德圣、博士生高晨钟与美国密西西比州立大学杜谦教授共同合作,提出了一种基于交互式Swin Transformer架构的跨模态遥感影像通用匹配技术,研究成果论文《SwinMatcher: Universal Cross-Modal Remote Sensing Image Matching With Interactive Swin Transformer》发表于遥感领域顶级期刊[IEEE Transactions on Geoscience and Remote Sensing,TGRS] (SCI一区,IF=8.6)。

跨模态图像匹配是支撑多源遥感信息协同利用的关键技术。然而,多源图像之间的模态差异和几何畸变在鲁棒性与泛化性方面对现有方法提出了挑战。不同成像原理会导致显著的非线性辐射差异,而视角变化与地形起伏则会引起尺度变化、旋转以及非刚性形变等几何不一致性。其次,尽管深度学习模型能够提取高级语义特征,但由于特征感知机制不足以及标注数据匮乏,其在跨模态匹配中的泛化能力仍然有限。如何设计在计算效率、跨模态泛化能力以及对几何畸变的鲁棒性之间取得平衡的方法,仍然是该领域的核心挑战。

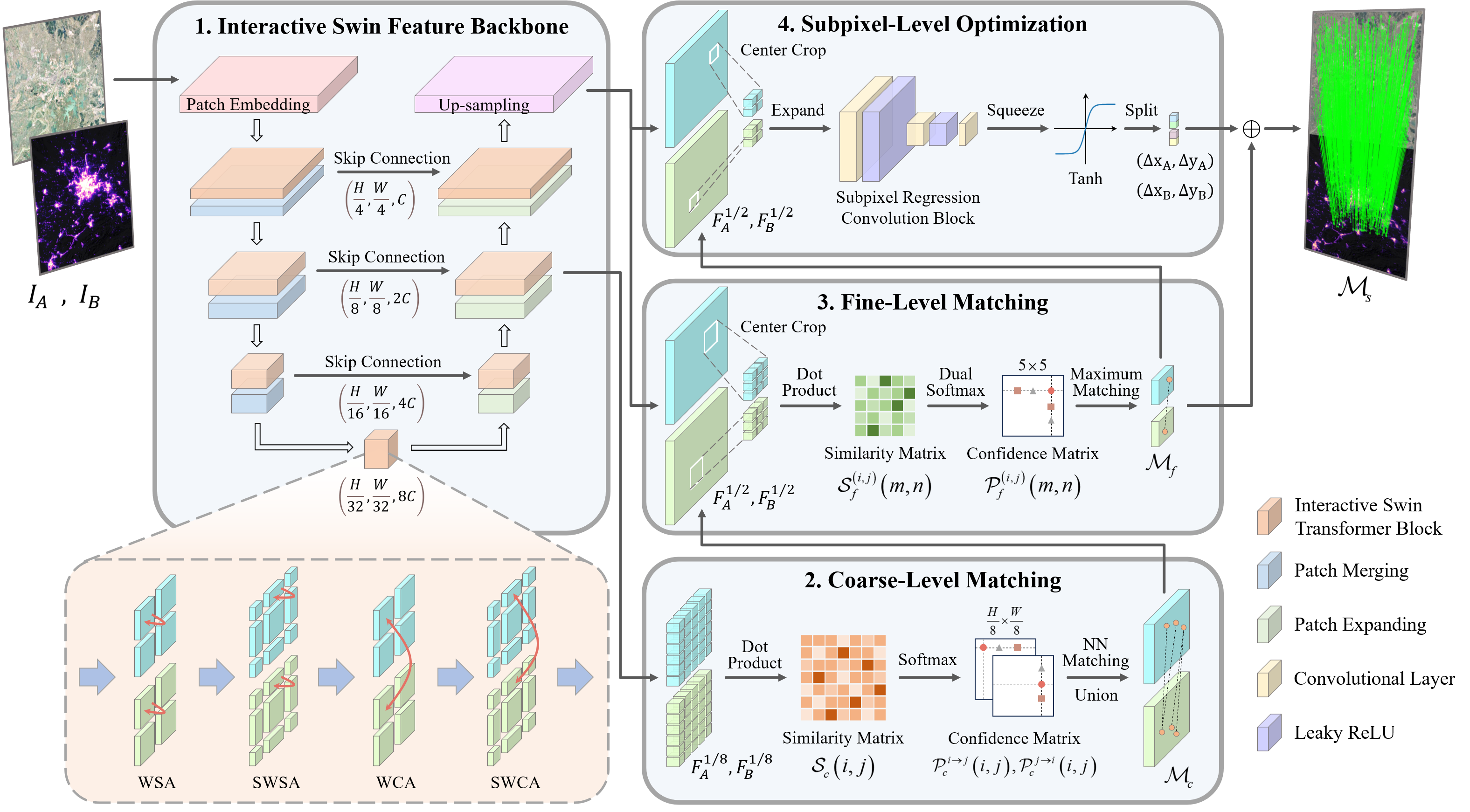

图1 SwinMatcher整体框架图

为实现跨模态场景下的特征交互,本文提出了一种基于Transformer架构的端到端匹配模型SwinMatcher,如图1所示。该方法创新性地在Swin Transformer的窗口/移位窗口自注意力(SWSA)机制基础上,提出了窗口/移位窗口交叉注意力(SWCA),从而实现高效的跨模态特征交互与多尺度上下文建模。同时,SwinMatcher集成了一个可学习的匹配模块,可以直接生成半稠密空间对应关系。

图2 所提跨模态遥感影像数据集

此外,该研究构建了一个大规模跨模态遥感图像匹配数据集,用于模型训练和算法测试。数据涵盖了可见光、红外、光谱、合成孔径雷达(SAR)、激光雷达(LiDAR)、地图、昼-夜等广泛影像模态,分布于12个具有代表性的场景。该数据集通过随机单应性变换生成,具备充分的模态多样性和场景复杂性。

图3 所提方法的跨模态遥感影像通用性表现

实验结果表明,所提方法在该数据集以及现有公开基准数据集上的表现均优于现有最先进方法,尤其在涉及模态与几何畸变耦合的复杂场景下展现出更强的鲁棒性。所提出的方法与数据集为跨模态遥感图像匹配提供了新的解决方案和评测基准。