近年来,深度学习在推动医学高光谱成像诊断的微观层面展现出巨大潜力,为精准识别病变组织、优化临床诊疗流程提供了全新可能。然而,现有研究模型多局限于单一任务或单一场景应用,未能对微观高光谱特征与空间信息进行稳健协同解释,导致高光谱数据中蕴含的丰富临床价值难以被充分挖掘,成为制约技术落地的关键瓶颈。

在医学场景中,病理组织的微观结构复杂且多样,边缘区域与中心区域的光谱特性存在细微差异,传统方法难以兼顾空间信息的全局关联性与光谱特征的局部特异性,导致特征提取的完整性和稳定性不足。同时,空间-光谱信息的协同建模缺乏灵活机制,使得下游任务(如肿瘤区域分割、病理类型分类)的性能提升受限,难以满足临床对高鲁棒性模型的需求。

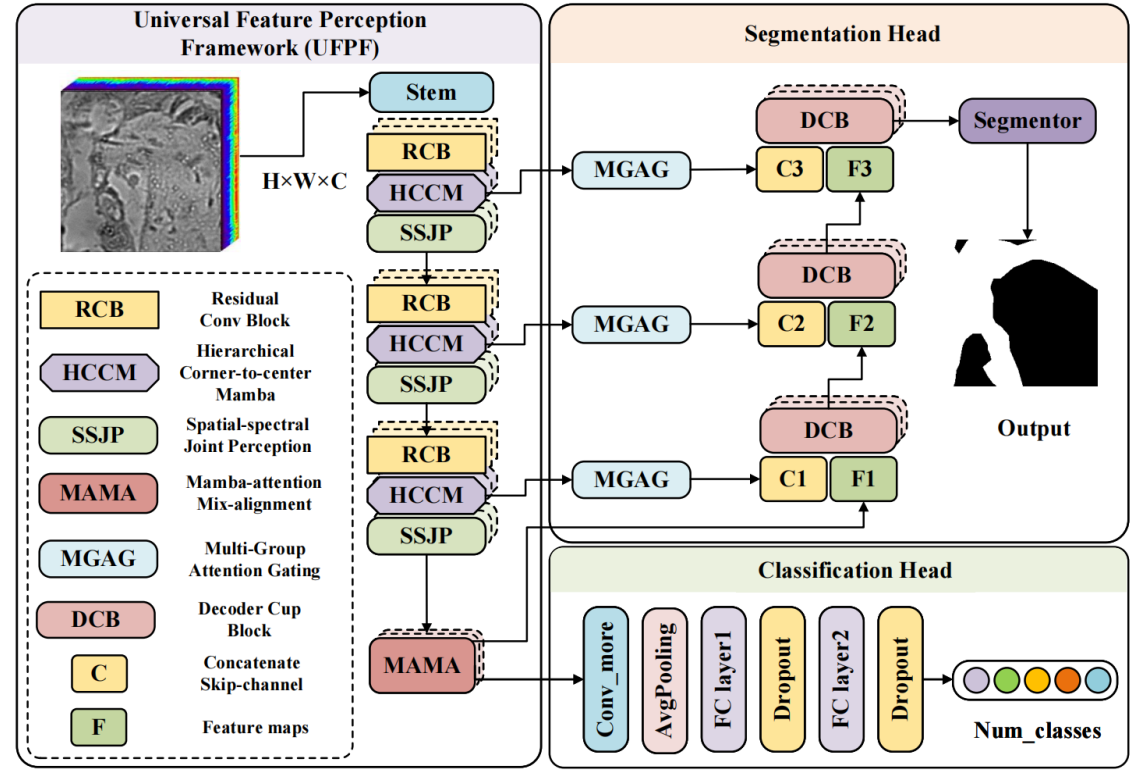

图1 所提出的模型整体架构

针对上述问题,研究团队提出了一种微观高光谱通用特征感知框架(UFPF),如图1所示。该框架能够高效提取高光谱数据的高质量空间-光谱特征,为下游任务提供稳健的特征基础。具体而言,这一创新框架通过分层的角点-中心曼巴结构(HCCM)捕捉不同的顺序空间最近邻关系,采用“渐进式中心聚焦”概念,从边缘信息开始强调,逐步将注意力从边缘向中心精炼,实现对复杂病理结构的全方位特征捕捉。在此基础上,开发了双路径空间-光谱联合感知模块(SSJM),通过互补机制充分挖掘空间与光谱信息中的潜在模式;同时设计曼巴-注意力混合对齐机制(MAMA),增强深度语义特征的优化对齐效果,进一步提升特征的判别能力。

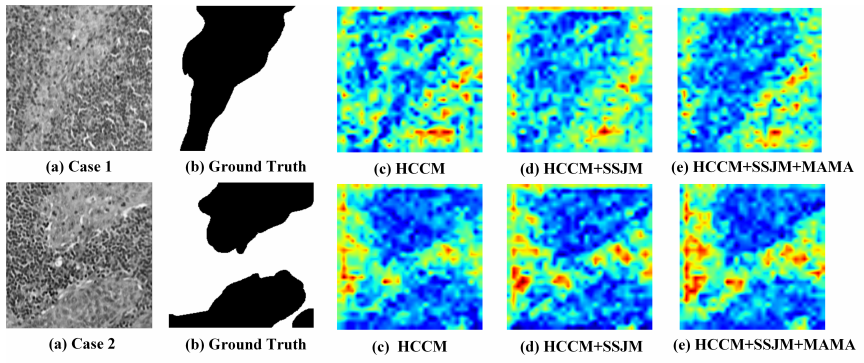

图2 模型可解释分析

图2展示了不同模块对病理癌区检测特征提取关注度的可解释性结果。可见HCCM初步捕捉癌组织区域特征,但存在响应模糊问题;融入SSJM后,空间-光谱信息协同增强,肿瘤与正常组织的特征区分度提升;再结合MAMA,深度语义对齐优化,特征关注度更精准聚焦病理癌区边界与核心区域,验证了多模块协同对高光谱脑病理癌区特征提取的增益,从可视化角度解释了模型架构的有效性。

研究团队在多个医学显微高光谱数据集上进行了对比实验,结果表明,所提方法在分割和分类两项下游任务上均优于当前最先进的算法。尤其在处理纹理结构复杂的病理切片时,仍能保持稳定的特征提取性能,此外,为高光谱技术在口腔鳞癌等临床病理诊断中的实用化推进提供了重要支撑。

该工作由北京理工大学信息与电子学院博士研究生秦赓、教授李伟、副研究员刘欢等人共同合作完成。论文成果《UFPF: A Universal Feature Perception Framework for Microscopic Hyperspectral Images》发表于图像处理、分析和理解方面的国际顶级期刊——《IEEE Transactions on Image Processing》(影响因子IF=13.7).

Paper DOI: 10.1109/TIP.2025.3594151