近期,北京理工大学信息与电子学院博士生高晨钟、李伟教授、硕士生翁德圣共同合作,提出了一种基于传统架构的任意源跨模态图像通用匹配方法,并配套提出了世界上首个同场景10源跨模态匹配数据集,研究成果论文《HOMO-Feature: Cross-Arbitrary-Modal Image Matching with Homomorphism of Organized Major Orientation》接收于计算机视觉领域三大顶会之一的[IEEE/CVF International Conference on Computer Vision, ICCV 2025] (CCF-A,h5-index=256,录用率24%)。

图像不变特征提取及匹配是计算机视觉中的一项基础技术,对于图像配准、单应性估计、相机定位、运动恢复结构等直接应用,以及图像融合、多源数据联合分析等间接应用都至关重要。随着传感器技术的快速发展,各类图像模态不断涌现。跨模态匹配,即由不同类型传感器采集的图像之间的匹配,则带来了更大的挑战。然而,目前针对通用跨模态图像匹配的研究仍不充分,尚缺乏一个基础性的通用范式。少有研究能够明确是否存在一种在任意图像模态下均具有高度不变性的基础特征,而不受制于具体模态类型。

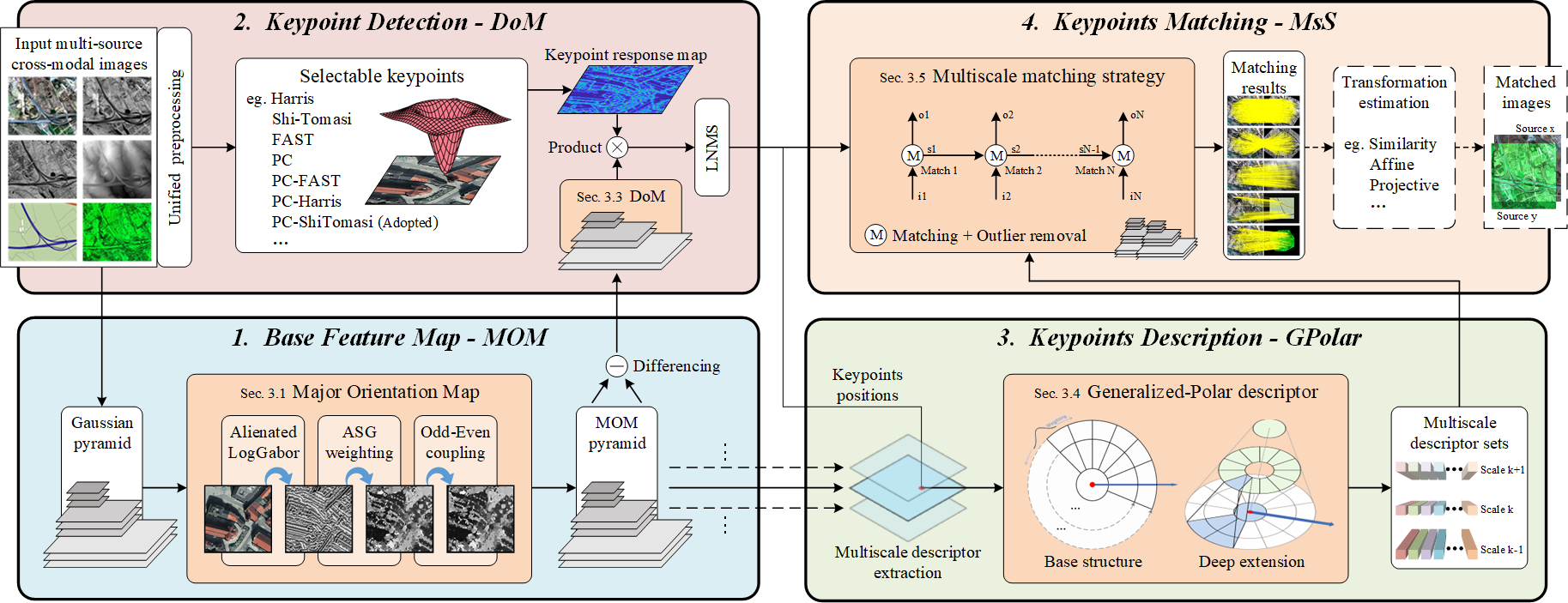

图1 HOMO整体框架图

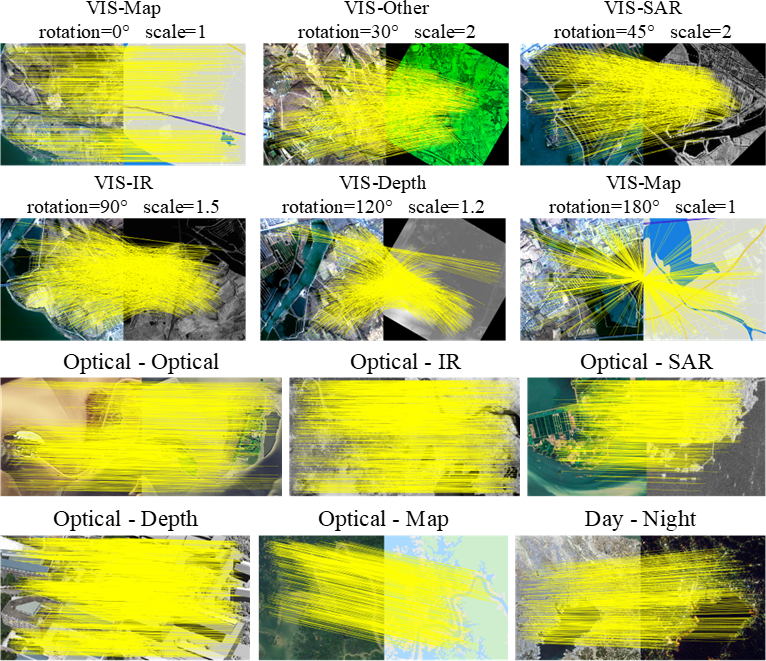

基于这一思考,该研究提出了HOMO-Feature(Homomorphism of Organized Major Orientation,组构主体方向同态性),是一种新颖的人工设计的传统架构算法,面向通用跨模态图像匹配,旨在提出一个能够有效处理非特定来源图像,同时兼顾旋转、尺度与纹理多样性的特征提取与匹配框架。与依赖黑箱式学习的深度网络模型不同,研究探索了一种可以理论推导的、明确定义的特征。方法的整体架构如图1所示,提出了一种新的基础不变特征-主体方向图(Major Orientation Map, MOM),该特征在跨模态图像的低层特征域具有高度不变性,并且具有物理可解释性。以MOM为核心,提出了一个完整的通用跨模态图像匹配流程。其中设计了多尺度策略(Multi-scale Strategy,MsS)、一种基于 MOM 差分的特征点增强方法(Difference of MOM,DoM),以及一种广义极坐标描述子(Generalized-Polar,GPolar)。实验证明,该方法在广泛的模态下均表现出显著的有效性,同时能够适应任意旋转和大尺度差异。

图2 HOMO广泛的图像模态通用性

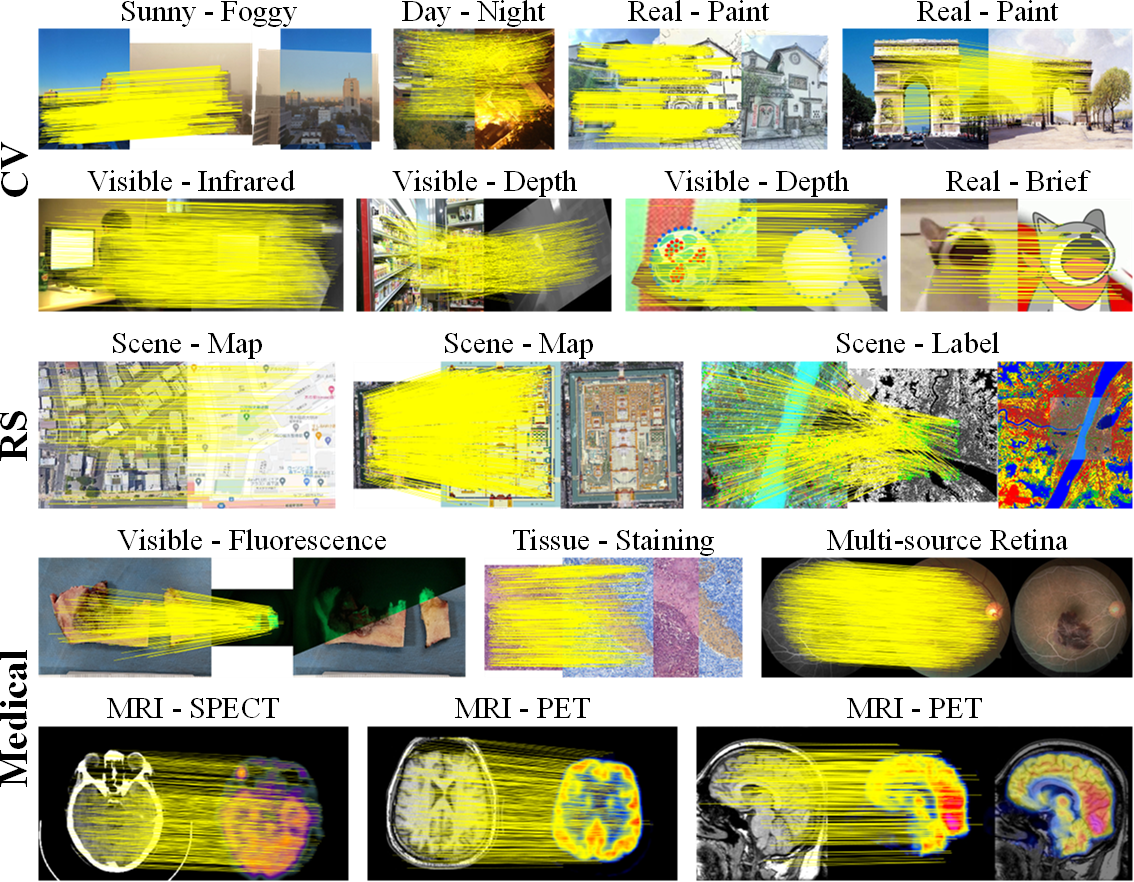

同时,该研究构建了一个通用跨模态区域数据集(General Cross-modal Zone, GCZ)。该数据集不仅能充分评估匹配方法,也具有较高的模型训练价值。GCZ 是首个在同一场景下包含超过 10 种模态的公开跨模态真实影像匹配数据集。

图3 GCZ数据集

算法demo:https://github.com/MrPingQi/HOMO-Feature_ImgMatching

会议页面:https://iccv.thecvf.com/virtual/2025/poster/871