近期,由北京理工大学信息与电子学院博士生高晨钟、博士后高云浩、李伟教授、硕士生翁德圣、李继轩、陶然教授、美国特拉华大学夏香根教授共同合作完成关于全模态通用实时图像匹配轻量级深度学习模型的研究,成果论文《MIFTr: Efficient Universal Image Matching with Modality-Invariant Feature Transformer》发表于遥感领域顶级期刊——IEEE Transactions on Geoscience and Remote Sensing(SCI一区,影响因子IF=8.6)。

图像匹配是智能图像处理中的基础技术,尤其是在多源遥感技术的广泛应用中。近年来,基于深度学习的图像匹配网络模型因其强大的感知能力和并行计算效率而成为研究热点。然而,大多数此类网络是为光学图像或特定模态设计的。直到最近,通用跨模态匹配才受到关注,但主流方法主要依赖于对现有模型进行微调或利用冻结权重的大规模预训练基础模型,很少关注针对跨模态场景设计的专用模型。

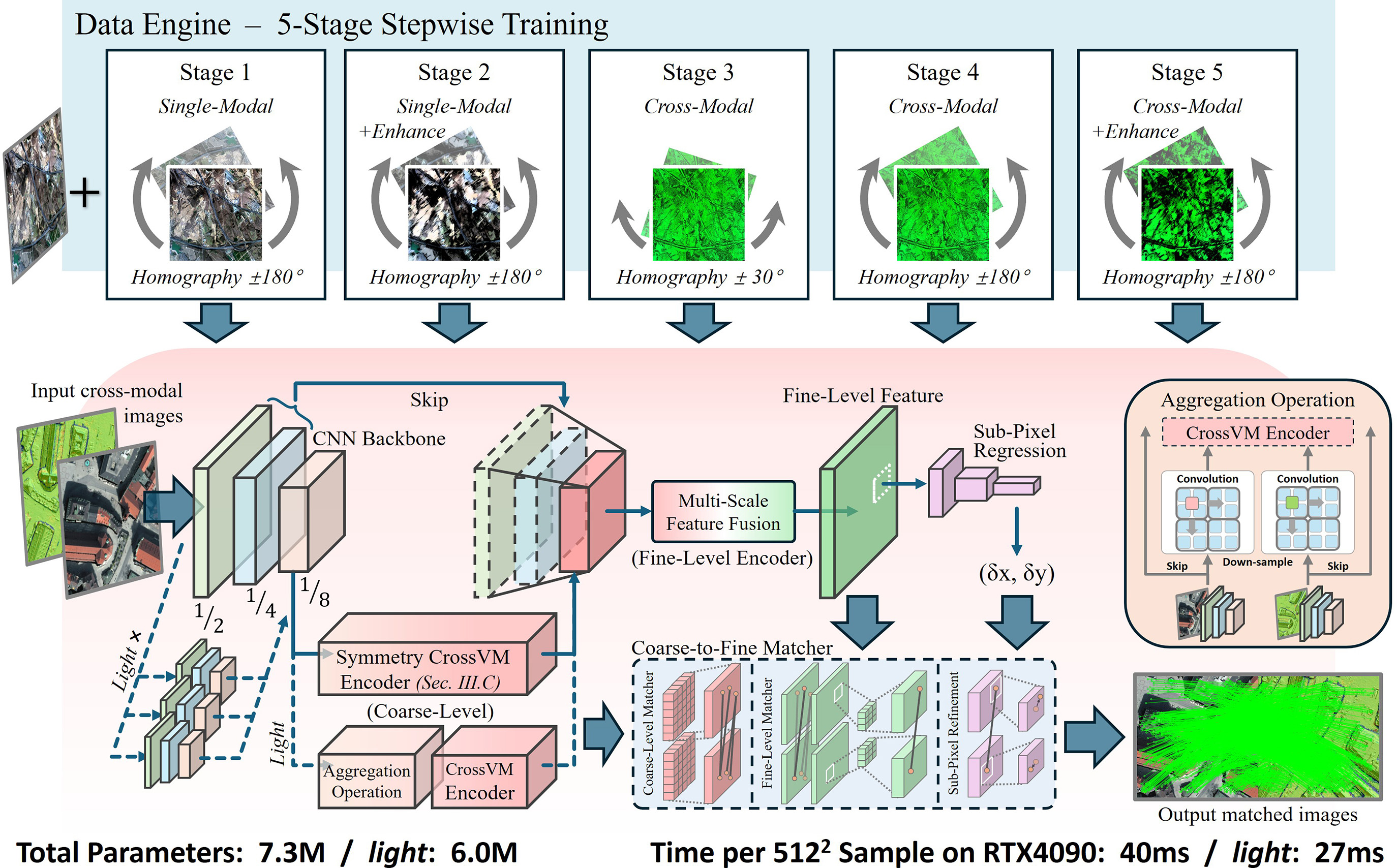

图1 提出的模态不变特征变换器(MIFTr)图像匹配网络模型

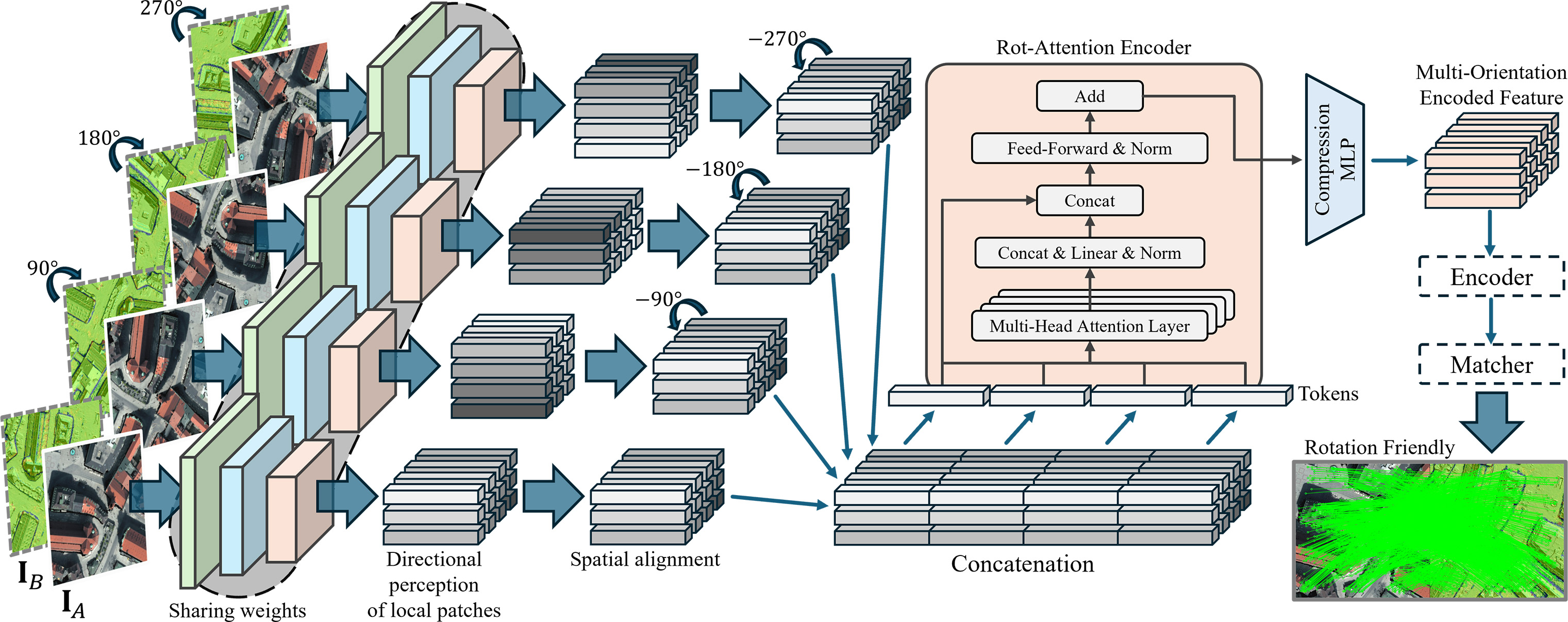

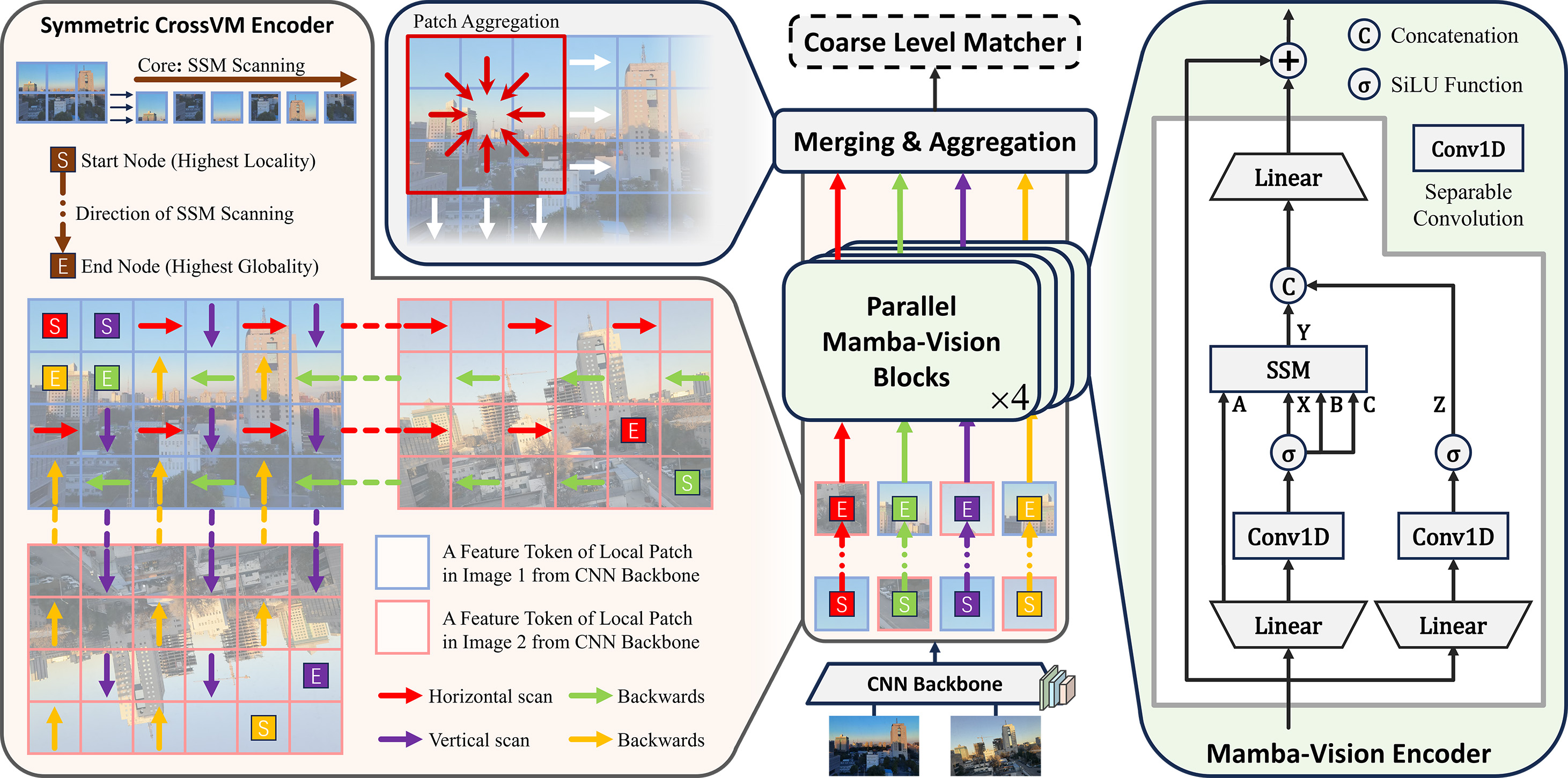

基于上述现状,研究提出了一种轻量级图像匹配模型——模态不变特征变换器(Modality-Invariant Feature Transformer,MIFTr),如图1所示,旨在实现兼具高精度与高效率的通用跨模态图像匹配。该模型采用无检测器(detector-free)半稠密(semi-dense)的匹配架构,创新性地引入了旋转多分支骨干网络来提取旋转鲁棒的局部特征(如图2所示),并结合最新的MambaVision 模型来构建一种对称式交互视觉Mamba(Cross-Vision-Mamba,CrossVM)模块作为核心的全局特征编码器(如图3所示)。通过粗匹配-精匹配-亚像素优化的多尺度特征匹配器实现亚像素级的高精度图像匹配。

图2 旋转多分支局部特征提取卷积骨干网络

MIFTr利用 MambaVision 模型实现高速的全局特征交互,通过结合对称跳跃扫描、特征聚合等针对性策略,将状态空间扫描机制有效融入了跨模态图像匹配流程,确保了在多种数据特征下仍具备强大的跨模态感知能力。该工作首次实现了Mamba/ MambaVision 模型在跨模态和遥感图像匹配中的应用,进一步挖掘并验证了 Mamba 架构在图像处理领域中的适用性。

图3 对称式交互视觉Mamba全局特征编码器

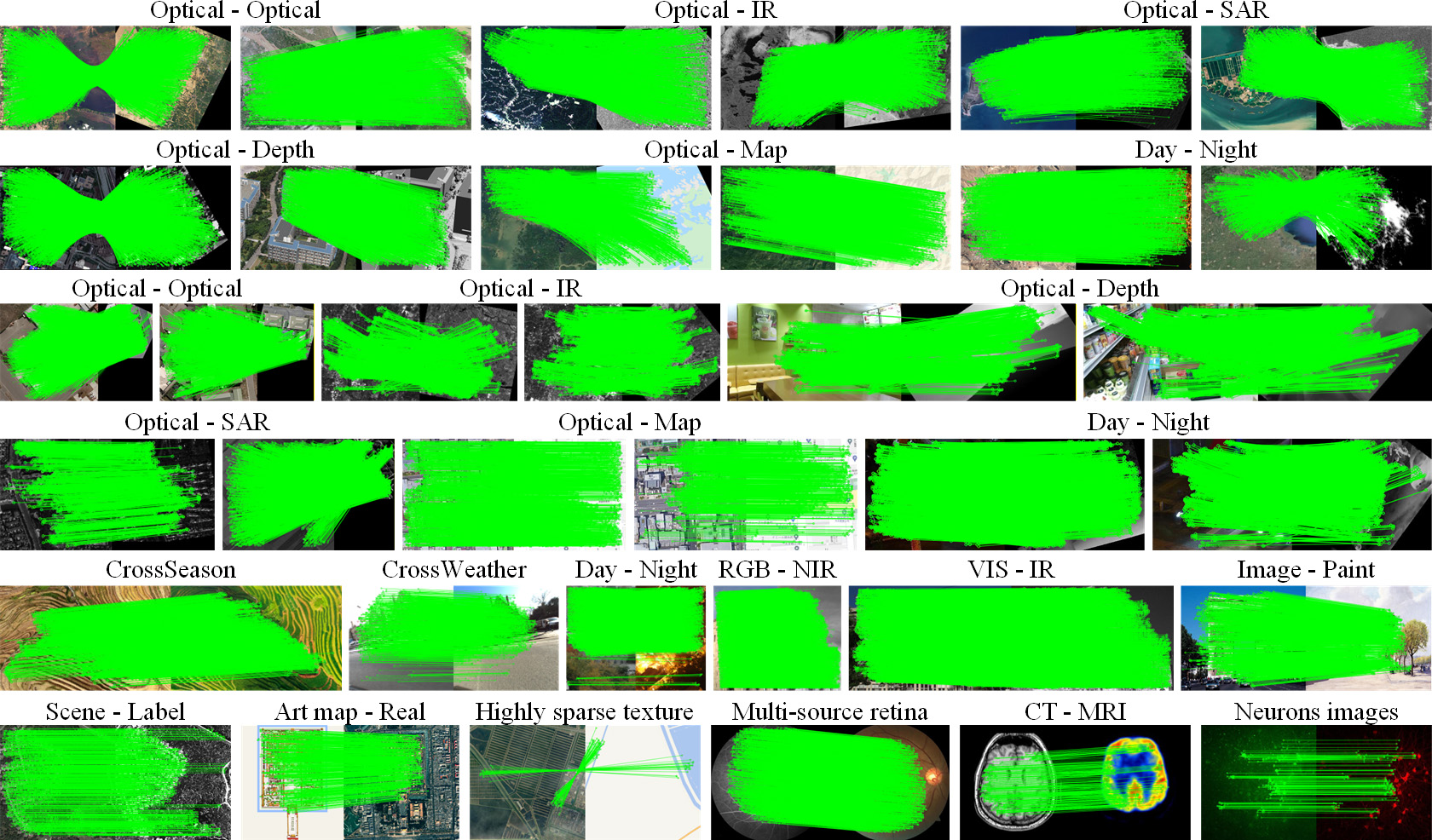

研究首次针对图像匹配神经网络模型开发了一个五阶段数据引擎(如图1所示),并自主构建了一套大规模跨模态真实世界数据集,以渐进式地引导模型训练,使所构建的轻量级模型能够泛化到广泛的遥感影像及其他一些潜在应用领域的多种图像模态中,如图4所示。

图4 所提模型的通用化跨模态图像匹配效果

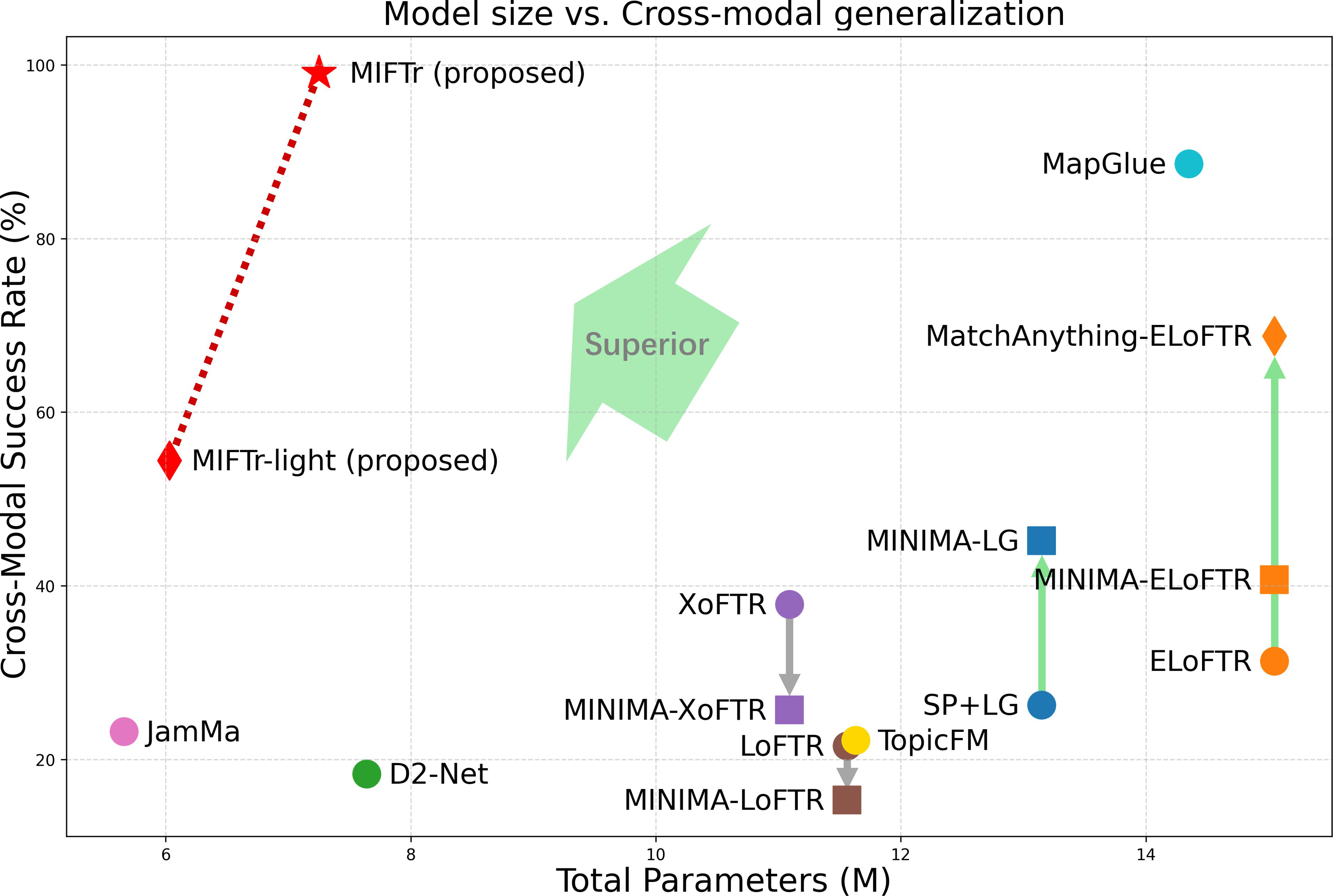

MIFTr 是国际上首个专门为通用跨模态图像匹配设计的轻量级端到端网络模型,在精度、效率和泛化能力之间取得了有效平衡(如图5所示),能够通用化处理多种图像模态和空间畸变,在性能上稳定超越现有最先进方法,在RTX4090上对512×512样本的处理时间少于40毫秒。此外,研究还提供了模型的简化版本 MIFTr-light,为典型工程场景提供更高效率的针对性解决方案。

图5 所提轻量级模型实现了参数体量与泛化性之间的有效平衡

MIFTr的成功为多源/多模态/实时/星载遥感成像的广泛应用提供了有效支撑,同时也展现出在其他领域的潜在应用价值。